“Aucun usage de LLM. On passe chaque texte à travers trois détecteurs d’IA différents avant publication”.

C’est ce que m’a dit un client il n’y a pas longtemps.

Je ne discuterai pas de ses choix personnels ici, ça n’a aucun intérêt.

Par contre, l’éventualité d’être pénalisé·e par Google (ou un autre algorithme) si on utilise un peu trop ChatGPT ou Gemini ça, c’est un vrai sujet.

Je ne vais pas garder le suspense très longtemps (c’est mauvais pour la pyramide inversée il paraît) : Google se contrefiche de savoir qui ou quoi a rédigé un texte.

Ce qu’il veut, c’est un contenu utile.

Dans ses propres termes : un contenu people first (écrit d’abord pour les gens).

Quelle drôle d’idée.

TL;DR

- Google se fiche de savoir qui (ou quoi) rédige, tant que le contenu est utile et conçu pour les humains.

- Les détecteurs IA ne sont que des mirages statistiques : ils ne prouvent rien et pénalisent parfois les meilleur·es rédacteur·rices web SEO.

- Le danger n’est pas l’IA, c’est le contenu générique.

- Injecter de l’expérience de terrain permet de respecter l’E‑E-A‑T et apporter de la valeur.

Non, Google ne pénalise pas le contenu IA

C’est écrit noir sur blanc sur Google Search Central :

Les systèmes de classement de Google visent à récompenser les contenus originaux et de haute qualité qui répondent aux critères de ce que nous appelons l’E-E-A‑T : l’expertise, l’expérience, la légitimité et la fiabilité. […] Nous nous concentrons sur la qualité du contenu plutôt que sur la façon dont il est produit. Cela nous permet de fournir des résultats fiables et de haute qualité aux utilisateurs depuis des années.

Comprenez, Google veut du contenu rédigé pour des humains, pas par des humains. La subtilité sémantique a son importance.

Pourquoi les détecteurs d’IA fonctionnent mal

Un détecteur d’IA ne cherche pas une empreinte digitale de l’IA (ChatGPT ne laisse pas une sorte de watermark IA dans les textes générés). Il ne fait que des statistiques sur la prévisibilité.

En pratique, les détecteurs s’appuient sur deux métriques principales pour rendre leur verdict. C’est là que le bât blesse, car ce sont des concepts purement mathématiques appliqués à la linguistique.

La perplexité (perplexity)

C’est la mesure de l’aléatoire dans un texte.

Un LLM est conçu pour prédire le mot suivant le plus probable. Plus un texte est logique et prévisible selon les probabilités statistiques, plus la perplexité est basse. Le problème est qu’un détecteur qui voit une perplexité basse crie à l’IA… alors même qu’un·e expert·e qui écrit de manière très structurée ou une documentation technique factuelle ont naturellement une perplexité basse.

La variabilité (burstiness)

Elle mesure la structure et le rythme des phrases.

Les humains ont une écriture “en rafales” (d’où le terme burst). Cela veut dire que nous mélangeons des phrases très longues et complexes avec des phrases courtes et percutantes. L’IA, elle, a tendance à produire des phrases de longueur et de structure assez uniformes pour rester “dans la moyenne”.

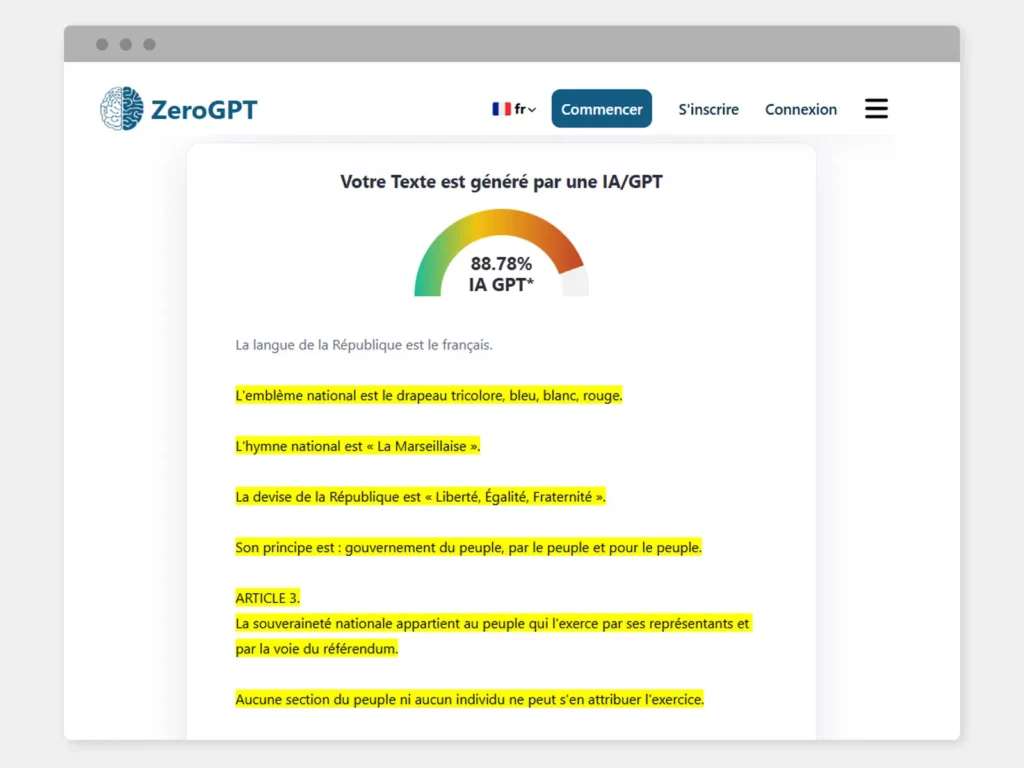

Là aussi, la limite apparaît vite. Face à un contenu très pédagogique (phrases courtes, sujet simple), le détecteur s’affole car il ne trouve pas cette “irrégularité” humaine. C’est ce qui se passe dans notre exemple de la Constitution.

⏩ Les détecteurs d’IA sont une espèce de radar automatique qui flashe non pas en fonction de la vitesse, mais de la régularité de la conduite. Si quelqu’un conduit trop bien, trop droit et à une vitesse trop constante, le radar décide que c’est un pilote automatique. Absurde, non ?

🗨️Et si, au lieu de viser un score “0% IA” sur un outil bancal, on visait ensemble un score “100% utile” pour l’utilisateur·rice ?

📩Je transforme vos idées, mots-clés et objectifs en contenus SEO capables de performer, indépendamment de l’outil utilisé et des tendances algorithmiques du moment.

Comptez également sur moi pour votre stratégie de contenu !

Et si on arrêtait d’utiliser les détecteurs d’IA ?

À première vue d’une certaine utilité, les détecteurs d’IA ne sont pas grand chose de plus qu’un grand mirage. Ils attirent l’attention, nous détournent du droit chemin et, au final, nous font perdre du temps en nous éloignant de nos vrais objectifs.

Je vois plusieurs inconvénients à leur utilisation :

- Loi de Goodhart : elle veut que, dès qu’une mesure devient un objectif, elle cesse d’être une bonne mesure. Aujourd’hui, on voit des rédacteurs et rédactrices forcer leur style pour paraître moins prévisibles aux yeux des détecteurs, ce qui dégrade souvent la qualité du contenu. Ou comment sacrifier l’UX.

- Absence de preuve : un détecteur ne peut pas prouver qu’un texte vient de ChatGPT (ou autre modèle). Il peut seulement dire : “Ce texte ressemble statistiquement à ce que GPT‑4 produirait s’il n’avait aucune consigne de style.”

- Obsolescence technique constante : les détecteurs ont toujours un train de retard. Ils sont souvent basés sur des modèles anciens pour tenter de détecter des productions de modèles plus récents. C’est une course perdue d’avance.

- Facilité de contournement : il suffit de quelques modifications triviales (changer un connecteur logique, ajouter une faute de frappe volontaire ou demander un ton spécifique) pour faire chuter le score de détection sans pour autant changer la valeur du contenu. L’outil est facile à duper, l’utilisateur·rice moins.

- Incohérence inter-outils : soumettre le même texte à trois détecteurs différents donne souvent trois résultats contradictoires. Quelle validité accorder à une “expertise” qui ne fait pas consensus ?

- Biais contre les non-natifs : les textes écrits par des personnes dont le français n’est pas la langue maternelle sont plus souvent signalés comme générés par une IA. Pourquoi ? Parce qu’ils utilisent un vocabulaire plus simple et des structures de phrases plus communes.

Le contenu robot-first comme vrai danger

Arrêtons de tourner autour du pot : le risque pour votre SEO n’est pas d’utiliser un LLM. C’est de mal l’utiliser. Sans un minimum de savoir-faire, on se retrouve vite avec du contenu robot-first, une espèce de soupe tiède, générée en un clic avec un prompt de trois mots, qui ne sert qu’à remplir l’espace entre deux balises H2.

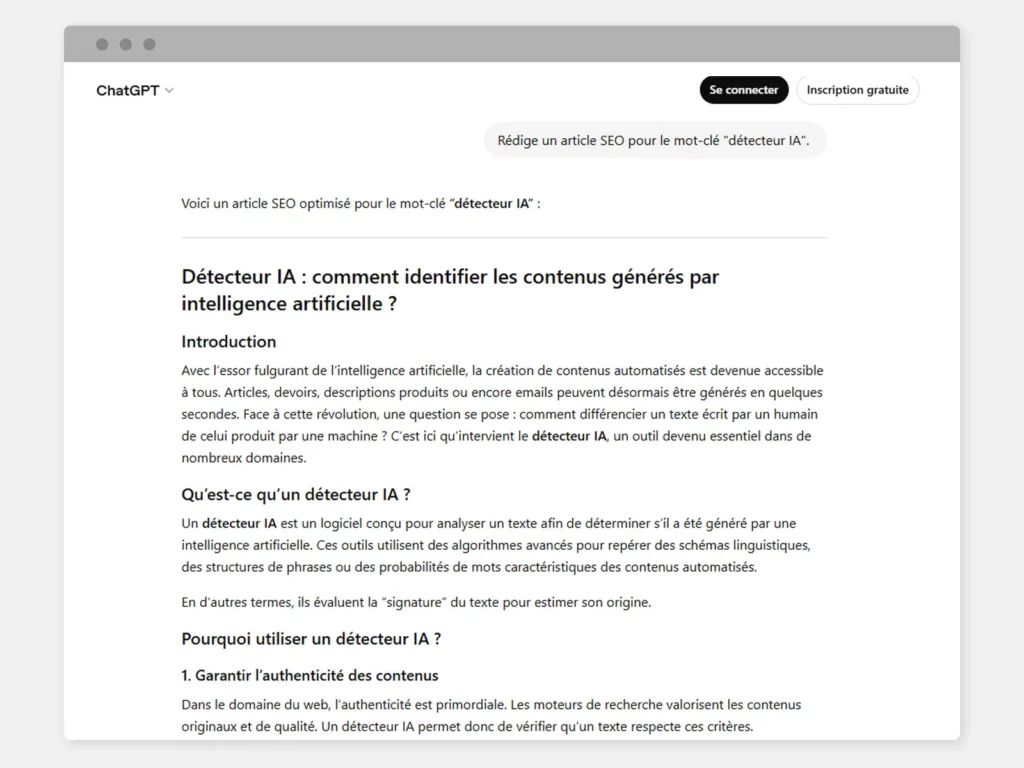

La capture d’écran nous montre ce que pourrait être cet article avec le même mot-clé, s’il était entièrement généré par ChatGPT : un résumé plus ou moins abouti des 10 000 autres articles déjà indexés. C’est l’exact contraire d’un article qui apporte de la valeur ajoutée.

Pourtant, Google et votre cible détestent la même chose :

- Le manque d’opinions tranchées : les IA sont programmées pour être consensuelles, pas pour avoir des points de vue. Résultat, le contenu n’engage personne.

- La circularité sémantique : cette fâcheuse tendance à répéter la même idée en changeant trois adjectifs pour atteindre le nombre de mots du brief.

- L’absence de preuves empiriques : une IA peut expliquer comment faire un audit SEO. Elle ne peut pas raconter comment elle a sauvé un site d’une pénalité manuelle à 2h du matin un dimanche.

Se raccrocher au E d’Expérience

Il était une fois le E‑A-T, pour Expertise, Authoritativeness (autorité) et Trustworthiness (fiabilité). Mais ça, c’était avant. Depuis 2022, Google a ajouté un deuxième “E”, pour Experience.

Ce n’est pas un hasard. Ce deuxième E, c’est tout ce que l’IA n’a jamais “vécu”. Elle n’a pas testé le produit dont elle parle. Elle n’a jamais ressenti la frustration d’un·e utilisateur·rice face à une interface mobile mal conçue. Elle n’a aucune anecdote de terrain, aucun vécu client. Si votre contenu se contente de régurgiter des faits sans y injecter cette couche d’expérience humaine, vous êtes remplaçable par un outil à 20 € par mois.

C’est précisément ce type de contenu que Google finira par balayer, qu’il ait été écrit par ChatGPT ou par un·e rédacteur·rice humain·e qui travaille comme un robot. Le problème n’est pas que le texte soit artificiel, c’est qu’il soit inutile.

Pour conclure : vive le E‑E-A‑T !

Le SEO en 2026, c’est de l’intelligence (humaine) augmentée.

Pendant que certain·es s’écharpent sur des scores de probabilités statistiques, les places en première page de Google, elles, sont trustées par celles et ceux qui ont compris la seule règle qui compte : l’utilité.

Google ne cherche pas à savoir si vous avez rédigé avec un stylo bic, une plume d’oie ou un LLM. Il cherche à savoir si votre contenu va résoudre le problème de l’internaute.

Vous avez besoin de contenu seo ?

Vous voulez du contenu qui performe sans jouer aux devinettes avec des détecteurs inutiles ?

Depuis 2011, j’aide les consultant·es SEO, les agences et les responsables marketing à publier du contenu SEO qui ranke… et les rapproche de leurs objectifs business !